Las Core Web Vitals se han convertido en un factor más de posicionamiento desde hace tiempo y en algunos casos nos trae algún que otro dolor de cabeza. En el pasado os compartí un script para crear un dashboard automatizado de seguimiento de las Core Web Vitals utilizando Google Spreadsheet. Hoy os voy a mostrar una forma sencilla de obtener un gráfico de burbujas con el que poder analizar las métricas de la competencia y además descargarnos un fichero excel con todos los datos.

Disclaimer: En el gráfico de burbujas que pinta el script sólo he tenido en cuenta dos de las métricas Core Web Vitals, en concreto el Largest Contentful Paint y el Cumulative Layout Shift, puesto que, bajo mi criterio, son las que en la mayoría de casos suelen darnos más quebraderos de cabeza, y son las más usuales a la hora de hacer alguna optimización en la web. Además de que sólo se puede pintar dos ejes. En el Excel que se descarga con el script sí podrás obtener también la métrica Total Blocking Time para cada competidor, que es un homólogo del First Input Delay que vemos en Page Speed Insights (la tercera Core Web Vital).

¿Qué obtenemos con el script?

Link al script en Google Colab

Para una query determinada, vamos a scrapear las SERPs y obtener datos de los dominios que posicionan.

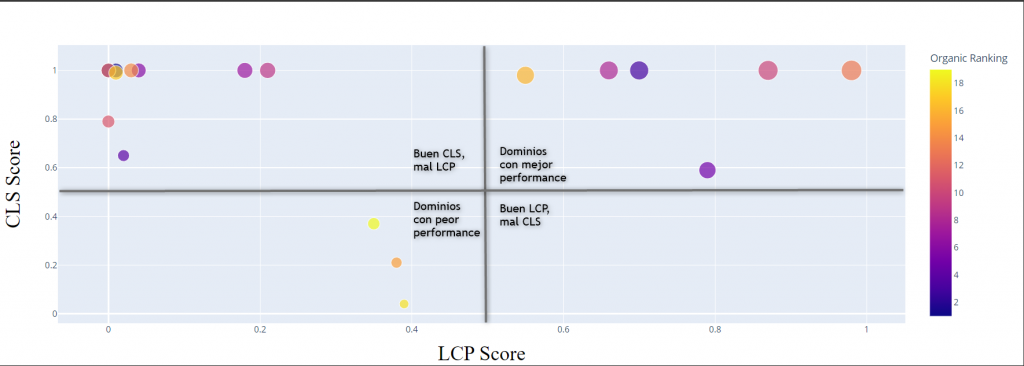

Con la ejecución obtenemos un gráfico de burbujas interactivo con el que podremos ir evaluando las diferentes métricas de cada dominio: LCP y CLS Score*, URL y ranking orgánico.

El score* va de 0-1, siendo 1 la mejor puntuación que se puede obtener y ha sido extraído de la API de Page Speed Insight.

Interpretación del gráfico

El gráfico se puede dividir en cuatro cuadrantes, y en función de en qué cuadrante se ubique la burbuja, se interpreta de una forma u otra:

Además, las burbujas más grandes son las que mejor score tienen.

El color de la burbuja es diferente según la posición orgánica del dominio: cuanto más morada, mejor ranking.

Tabla comparativa en Excel

Además, se va a descargar automáticamente una tabla comparativa en Excel con todos los datos:

¿Cómo usar el script?

En primer lugar, necesitas un API Key gratuito de Page Speed.

Esto lo puedes conseguir aquí, simplemente clicka el botón y crea un nuevo proyecto, después obtendrás un API Key que será el que tendremos que introducir en nuestro script.

Una vez tengas esto, vuelve a Google Colab y simplemente pulsa Ctrl+F9.

Te pedirá primero una keyword, y tendrás que introducir la query sobre la que quieres hacer el análisis.

Después te pedirá el API Key, que es la que hemos obtenido antes.

Ahora simplemente espera, puede tardar en ejecutarse 9-10 minutos, ten paciencia y aprovecha para barrer la casa o hacer gazpacho.

Conclusiones

El script es útil para hacer un benchmark de la competencia y evaluar cómo de bien/mal está tu competencia en cuanto a web performance, además de obtener una tabla comparativa en Excel con todos los datos.

Puede ser útil para evaluar si es un elemento importante a trabajar en tu estrategia cuando el resto ya lo hayas optimizado al máximo, además de que en algunos gráfico se ve una correlación entre buen performance y mejor posición orgánica.

Por otro lado, lo cierto, y desde mi experiencia, es que en muchos casos las métricas de performance no parecen ser un elemento diferenciador a la hora de posicionar para una query. He visto dominios con métricas de carga terribles y estar mucho mejor posicionados que otros con un performance impoluto. En mi opinión, creo que puede ser un factor decisivo sólo en situaciones en las que otras señales mucho más potentes (contenido, experiencia, E-A-T, etc.) están muy igualadas.

Si te ha resultado útil quiero que sepas que me encanta la pizza, y que me puedes invitar a una aquí 😊

Sobre el autor

Especialista SEO con gran foco en el área técnica. Entusiasta de la programación, en especial Python y Javascript, y la aplicación de ésta en el ámbito SEO para automatizar procesos o profundizar en ciertos ámbitos como el web scraping o el uso de APIs. He trabajado en proyectos SEO de muy diferente tamaño y sector lo que me permite obtener una perspectiva 360º de cómo trabajarlo.